AI推理 CPU的拿手好戏!细说AMD EPYC 9004的三大优势

近几年,生成式AI一浪高过一浪,对于各种AI大模型的训练、推理也提出了越来越苛刻的要求。

一般而言,推理工作不需要庞大的GPU加速器集群,更适合交给CPU处理器,尤其专门面向服务器和数据中心的CPU产品。

所谓推理(Inference),就是将训练好的AI模型应用于新的数据和场景。模型利学习到的规律进行预测、分类或生成新内容,也就是让AI在实际应用中落地的过程(是骡子是马拉出来遛遛),比如医疗诊断、自动驾驶、自然语言理解等领域。

推理并不需要超强的算力,但因为涉及各种各样的场景和应用,更强调硬件的通用型,CPU天然就是干这活儿的,尤其是强大的服务器型CPU。

说到服务器,相信对大多数人而言既陌生又熟悉。陌生的是鲜有人能接触它们、使用它们、深入了解它们;熟悉的是我们大多数网络服务都依赖于它们提供支撑,也经常听说相关产品和技术的介绍。

所谓服务器,就是负责执行计算任务、处理请求、存储数据以及提供各种服务的平台。

任何服务器都由多个单元模块组成,而把它们有机地组织在一起的,叫做“服务器机头”,简称“机头”,也就是我们常说的“火车跑得快,全凭车头带”。

所谓机头,就是用于管理和协调计算集群的服务器节点,通常位于系统架构的前端,用于处理客户端的初始请求,执行负载均衡、任务调度、资源管理、集群状态监控等工作。

它包括多个硬件组件,比如CPU处理器、内存、硬盘、主板、网络接口等,一定程度上类似我们使用的PC。

CPU处理器则是机头中的核心硬件组件,也是整个服务器的“大脑”,决定了服务器处理任务的速度和效率。

在大规模数据中心或计算集群中,多个服务器节点可以构成一个服务器集群,而每个机头有一个或多个CPU,彼此协调处理大量的并发任务。

优秀的CPU可以支撑优秀的机头,优秀的机头可以支撑优秀的服务器,而优秀的服务器可以优秀地完成AI推理工作。

图源:Pixabay

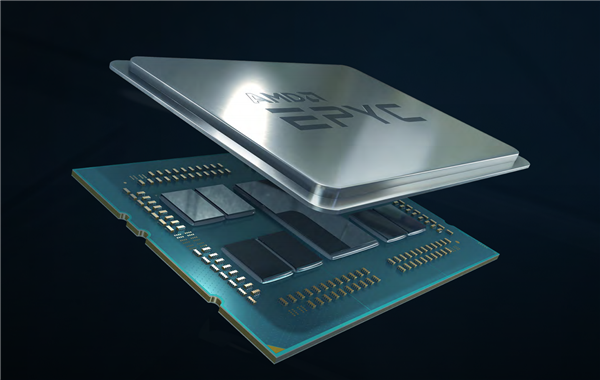

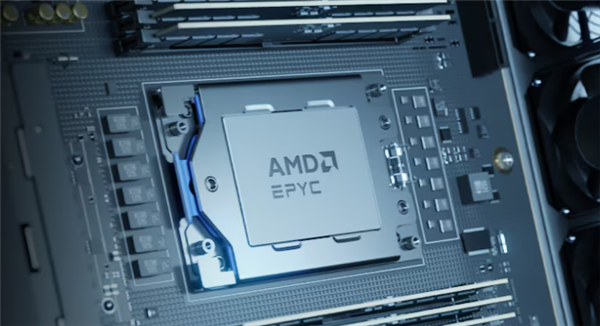

说到服务器CPU,近些年来AMD EPYC大出风头,凭借领先的产品规格和性能、超高的能效和稳定性、出色的性价比,一直独领风骚。

根据市调机构Mercury Research的数据,截止2024年第二季度,AMD EPYC已经占据整个服务器CPU市场的24.1%,按照收入计算份额高达33.7%,双双创下新纪录。

最新一代的Genoa EPYC 9004系列,更是达到了全新的高度,有着卓越的架构设计(Zen 4)、业界最高的计算密度、最高的性能、最高的效率。

或者直白地说有,该系列有着最多的核心、最大的缓存、最高的频率,以及极为丰富的技术特性。

AMD的优良传统也没忘,性价比极高,在服务器和数据中心领域是无可争议的首选。

在AI推理应用中,AMD EPYC 9004系列的优势十分明显,而且非常有针对性。

一是超多的核心、超高的频率。

EPYC 9004系列最多做到了96核心192线程,可以更高效地并行处理多个推理工作负载,大大提升效率。

同时提供16/24/32/48/64/84等不同核心数,可以根据实际需求灵活选择核心数量,提高投入产出比。

核心多了,频率也没丢,基础频率最高可达4.1GHz,而加速频率最高能够跑到4.4GHz,即便是96核心型号也能加速到3.7GHz,而且支持更多核心同时达到最高频率。

这对于服务器CPU来说相当罕见,这无疑能大大加速推理工作的速度,无论单个任务独自进行还是多个任务并行处理都得心应手。

二是超大的缓存。

对比上代产品Milan EPYC 9003系列,每个核心的二级缓存翻倍至1MB,每八个核心共享32MB三级缓存,总计最多可达96MB二级缓存、384MB三级缓存。

集成了3D V-Cache堆叠缓存的Genoa-X,更是可以让每八核核心共享96MB三级缓存,总容量最多达惊人的1152MB,史上第一次超越1GB。

大容量缓存,可以给推理业务提供更强的助力,提高指令命中率,降低数据转移和通信延迟。

三是超高的内存频率和带宽。

EPYC 9004系列不仅支持多达128条PCIe 5.0高速连接通道,还支持12个DDR5内存通道,最高频率4800MT/s,可提供460.8GB/s的惊人带宽,双路系统的带宽可超过960GB/s。

内存性能对于推理工作也至关重要,可以容纳更大的模型、更多的负载。

EPYC 9004系列型号众多,针对不同的应用场景,需要筛选最匹配的型号,以发挥最大性能、最高效率。

针对AI推理应用,有三个型号非常合适:

EPYC 9534:

64核心128线程,三级缓存256MB,基础频率2.45GHz,全核加速频率3.55GHz,最高频率3.7GHz,默认热设计功耗280W。

多核心,大缓存,频率也不低,适合经常并行执行多个乃至大量推理任务,可以保证足够高的效率。

EPYC 9454:

48核心96线程,三级缓存256MB,基础频率2.75GHz,全核加速频率3.65GHz,最高频率3.8GHz,默认热设计功耗290W。

核心、缓存、频率都非常均衡,如果推理任务多变,选它就对了,多任务、单任务都可以轻松应对。

EPYC 9334:

32核心48线程,三级缓存128MB,基础频率2.7GHz,全核加速频率3.85GHz,最高频率3.9GHz,默认热设计功耗210W。

核心数依然不少,频率相对更高,功耗也低得多,适合少量但负载相对较高的推理任务,可以专心快速完成。

结语

总的来说,生成式AI的时代,我们经常谈论AI训练,谈论几千、几万块加速卡的壮观,但不要忘了AI推理同样至关重要。

它是对训练成果的检验,是AI的实践应用,而且不需要庞大的计算集群,传统的CPU机头组成的服务器集群就可以轻松应对。

AMD EPYC历经四代发展,已经成为全能型选手,几乎可以胜任你能想到的任何计算工作,用于AI推理自然也是最佳选择。

多核心、大缓存、高频率、高内存、高能效、高性价比……AMD EPYC凭借自己的优秀素质,正在各行各业发挥力量,也是生成式AI时代不可或缺的支柱。

内容转载自:快科技